近日,中国科学院西安光机所光谱成像技术研究室王荃研究员团队在计算机视觉领域的零样本异常检测与定位方向取得新进展,相关成果被计算机视觉与模式识别大会(The IEEE/CVF Conference on Computer Vision and Pattern Recognition, CVPR 2026)接收。论文第一作者为西安光机所2024级硕士研究生胡明,通讯作者为武汉大学中南医院胡聪博士、西安光机所胡炳樑研究员以及王荃研究员,西安光机所为第一通讯单位。

随着工业质检、医学影像分析等应用需求不断增长,异常检测技术日益受到关注。然而,实际场景中异常样本往往稀缺甚至难以获取,传统依赖标注数据的监督学习方法面临瓶颈。

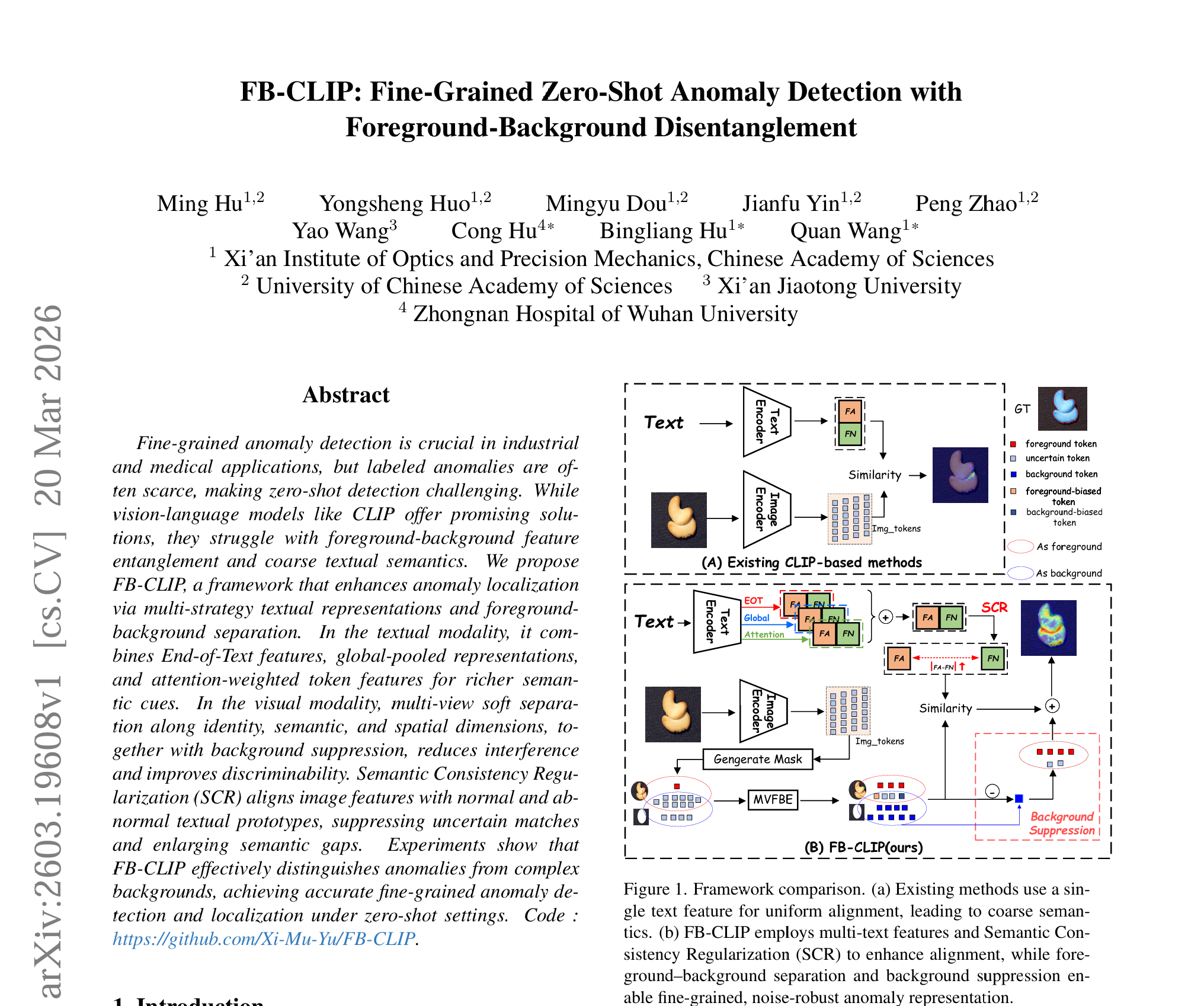

基于视觉-语言模型的零样本异常检测方法,凭借大规模预训练知识,无需异常标注即可实现检测,但在细粒度异常检测任务中,该方法仍面临三大挑战:一是模型难以区分前景目标与复杂背景,异常特征易与背景混杂,影响检测精度;二是依赖单一文本表示,语义表达能力有限,难以为异常判别提供精细依据;三是跨模态对齐过程中,图像与文本的语义匹配存在不确定性,制约了模型性能提升。

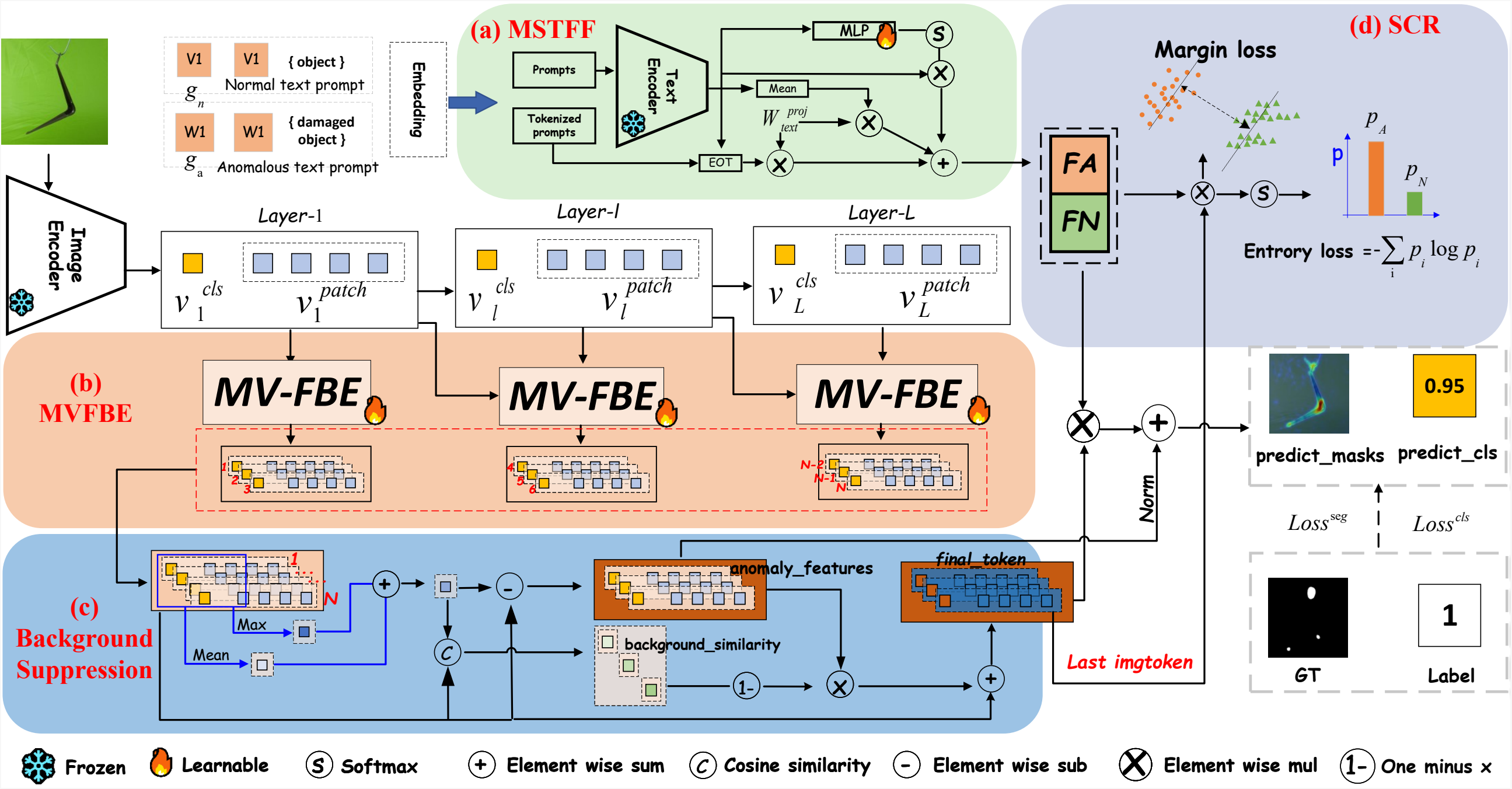

图 FB-CLIP整体结构。(a) 多策略文本特征融合(MSTFF)生成任务感知的文本嵌入;(b) 多视角前景-背景增强(MVFBE)分离并增强前景与背景特征;(c) 背景抑制(Background Suppression)减少残余背景干扰;(d) 语义一致性正则化(SCR)强化置信且具有判别力的视觉-文本对齐。

针对上述问题,研究团队提出了新型框架——FB-CLIP(Foreground-Background Disentangled CLIP)。该框架从三个层面进行创新:

在文本建模上,提出多策略文本特征融合方法,通过结合句子级表示、全局上下文信息及注意力加权特征,构建更丰富的任务感知语义表示,提升模型对异常语义的理解能力;

在视觉建模上,设计多视角前景-背景分离机制,从语义、空间、结构等维度解耦图像特征,并借助背景抑制策略减少复杂场景中的干扰信息,使模型更精准地聚焦异常区域;

在跨模态对齐上,引入语义一致性正则化约束,通过提升预测置信度并拉大正常与异常样本的语义间隔,增强模型对异常的判别能力。

实验结果表明,FB-CLIP在多个工业检测和医学影像数据集上均取得了优异性能,尤其在细粒度异常定位任务中表现突出,整体性能达到国际领先水平。该方法无需异常样本标注,即可实现对复杂场景中微小异常的精准检测与定位,具有良好的实际应用前景。

该成果有望应用于医学影像辅助诊断、工业缺陷检测等领域。

西安光机所王荃研究员团队长期深耕于计算机视觉与生物医学成像、脑机智能等交叉方向研究,近年来在相关领域持续取得一系列重要进展,相关成果发表于CVPR 2025、Pattern Recognition等。

IEEE/CVF计算机视觉与模式识别会议是计算机视觉领域最具影响力的国际学术会议之一,被中国计算机学会(CCF)评为A类会议。